Target Penyerangan Dalam Kecerdasan Buatan: Ancaman dan Tantangan di Era Digital

Dalam beberapa tahun terakhir, kecerdasan buatan (AI) telah berkembang dengan sangat cepat dan telah menghasilkan banyak keuntungan dalam berbagai bidang, seperti manufaktur, kesehatan, dan keuangan. Namun, di balik potensinya yang besar, AI juga membawa risiko dan kerentanan yang harus diwaspadai. Salah satu kekhawatiran utama adalah kemungkinan penyalahgunaan AI untuk tujuan jahat, seperti serangan siber, penipuan, dan penyebaran informasi yang salah.

Target Serangan Umum Sistem AI

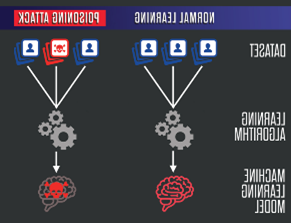

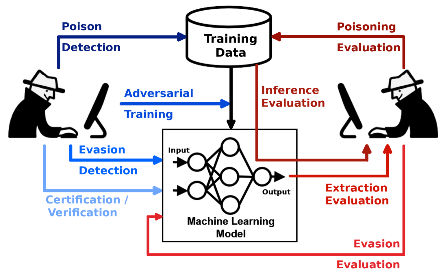

- Serangan terhadap data:

Data adalah sumber AI, dan kerusakan atau manipulasi data dapat menghasilkan hasil yang tidak akurat atau berbahaya. Penyerang dapat menyuntikkan data palsu untuk melatih model AI agar menghasilkan hasil yang salah, atau mereka dapat mencuri, menghapus, atau mengubah data pelatihan AI.

- Serangan terhadap model:

Model AI adalah algoritma kompleks yang dipelajari dari data. Penyerang dapat menggunakan kerentanan dalam model AI untuk memanipulasi perilakunya. Mereka dapat melatih model AI dengan data yang bias untuk menghasilkan hasil yang diskriminatif, atau mereka dapat menemukan input yang tidak terduga yang menyebabkan model AI membuat prediksi yang salah.

- Serangan terhadap infrastruktur:

Sistem AI berjalan pada infrastruktur fisik dan digital, seperti server, jaringan, dan perangkat keras. Penyerang dapat menyerang infrastruktur ini untuk mengganggu atau melumpuhkan operasi AI. Contohnya, penyerang dapat melakukan serangan Denial-of-Service (DoS) untuk membuat sistem AI tidak dapat diakses, atau mereka dapat meretas server untuk mencuri data atau model AI.

Dampak Serangan AI

- Kerugian keuangan:

Serangan AI dapat mengakibatkan kerugian besar bagi organisasi yang mengandalkannya. Sebagai contoh, serangan terhadap sistem AI lembaga keuangan dapat menyebabkan dana dicuri atau gangguan perdagangan.

- Kerusakan reputasi:

Serangan AI dapat merusak reputasi organisasi yang menggunakannya. Contohnya, jika sistem AI yang digunakan perusahaan untuk membuat keputusan perekrutan ditemukan bias terhadap kelompok tertentu, hal itu dapat menyebabkan citra perusahaan menjadi buruk dan mengurangi pelanggan.

- Keamanan dan keselamatan publik:

Serangan terhadap AI dapat membahayakan keamanan dan keselamatan publik. Sebagai contoh, serangan terhadap sistem AI yang mengontrol kendaraan otonom dapat menyebabkan kecelakaan.

- Manipulasi sosial dan politik:

AI dapat memanipulasi opini publik dan mengganggu proses politik. Penyerang dapat menggunakan kecerdasan buatan untuk membuat berita palsu, menyebarkan propaganda, dan memengaruhi hasil pemilu.

Mitigasi Potensi Serangan AI

Untuk mengurangi kemungkinan serangan AI, maka beberapa hal yang dapat dilakukan adalah sebagai berikut:

- Memastikan keamanan data:

Kontrol keamanan yang kuat seperti enkripsi dan kontrol akses harus digunakan untuk melindungi data AI.

- Membangun model AI yang aman:

Mengidentifikasi dan memperbaiki kerentanan dan menerapkan teknik keamanan seperti autentikasi dan otorisasi adalah bagian dari desain dan uji coba model AI yang mempertimbangkan keamanan.

- Melindungi Infrastruktur AI:

Kontrol keamanan yang kuat, seperti firewall dan sistem deteksi intrusi, harus digunakan untuk melindungi infrastruktur AI.

- Meningkatkan kesadaran tentang potensi bahaya AI:

Meningkatkan kesadaran tentang potensi bahaya AI dan cara mencegahnya sangat penting. Ini mencakup memberikan instruksi kepada karyawan tentang praktik terbaik keamanan dan ancaman AI.

- Mengembangkan kerangka kerja peraturan:

Pengembangan AI yang aman dan etis harus diatur oleh kerangka kerja. Hasilnya adalah bahwa kecerdasan buatan adalah alat yang efektif yang dapat bermanfaat bagi masyarakat. Namun, untuk memastikan bahwa AI digunakan secara aman dan bertanggung jawab, kita harus menyadari risiko dan kerentanan yang terkait dengannya dengan mengambil langkah-langkah seperti diatas untuk mengurangi berbagai resiko yang ada.

Penting untuk diingat bahwa bidang AI berkembang pesat, dan ada ancaman dan kerentanan baru yang muncul setiap saat. Oleh karena itu, penting untuk terus memantau perkembangan terbaru dalam bidang ini dan memperbarui metode untuk mengurangi risiko secara berkelanjutan.

Catatan:

Artikel ini hanya membahas beberapa aspek penyerangan AI. Banyak lagi topik yang dapat dibahas, seperti etika AI, akuntabilitas AI, dan dampak AI pada masyarakat dalam jangka panjang.

Sumber :